自郭碧婷與向佐喜結連理,名正言順地嫁入豪門後,其演藝事業一度近乎停滯。然而,在娛樂圈這片輿論場中,圍繞她的話題卻始終未曾間斷。

此圖片源自網絡

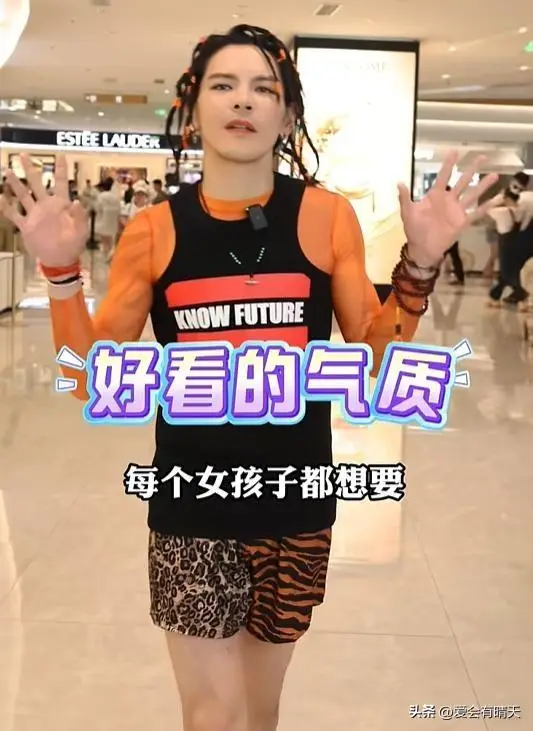

近日,有網友於國外意外邂逅41歲的郭碧婷。身爲豪門闊太的她,扎着俏皮的衝天丸子頭,身着黑色寬松長袖上衣,搭配咖色長褲,腳下踩着人字拖,手中拎着帆布包,悠然地在街頭闲逛。

此圖片來源於網絡

單從穿搭而言,她看上去就如同普通路人一般,全無明星的架子。身着的衣物十分寬松,整體給人一種極爲隨性的感覺。不禁讓人猜想,是不是在步入婚姻之後,女孩子就都不太熱衷於精心裝扮自己了呢。

展開全文

此圖片源於網絡

當然,除了郭碧婷,她的父親也難得現身。郭爸爸一身裝扮十分休闲,腳蹬白色運動鞋,頭戴白色棒球帽,這穿搭,妥妥的青春範兒。

此圖片源自網絡

她的穿着打扮洋溢着青春氣息,面容更是光潔緊致,不見絲毫皺紋,實在令人豔羨!

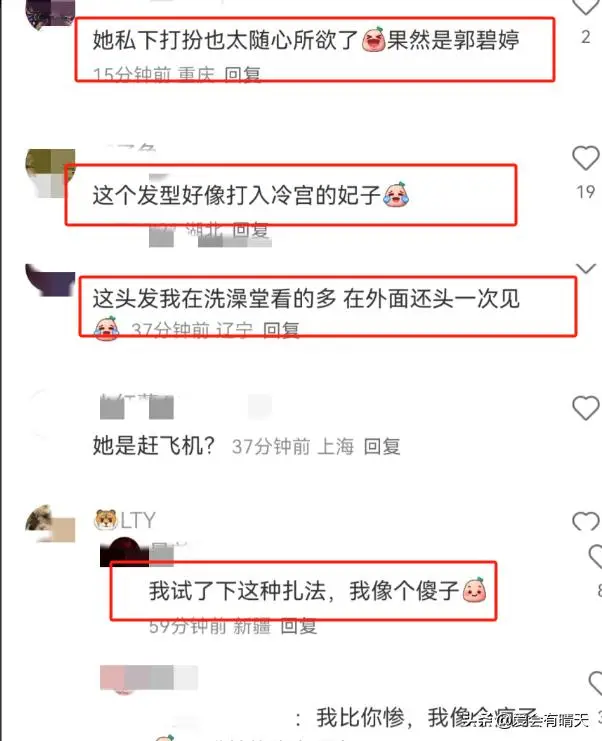

然而,當看到郭碧婷此番造型時,衆多網友迅速趕來“喫瓜”。有人調侃她宛如剛被打入冷宮的妃子,這發型簡直與澡堂阿姨的同款,全憑自身超高的顏值在苦苦支撐。

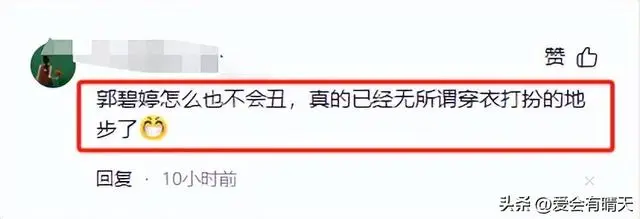

網友一邊吐槽,一邊酸溜溜地說,同樣的發型,自己扎起來就像逃難的,而郭碧婷扎起來卻宛如慵懶貴婦。真是人跟人沒法比,郭碧婷的底子太好了,無論怎樣都不會難看。感覺她現在在穿衣打扮方面都已經不太在意了。

是不是好看的衣裳都被老公順走啦,只給我留下這些黯淡的來穿呀。

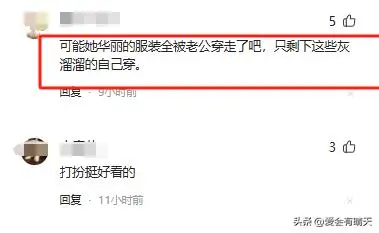

尤其值得一說的是,她不光以素顏現身街頭,還領着自己的父親逛商場,甚至蹲在路邊玩手機!明明身爲向家的少奶奶,難道如今豪門媳婦都如此隨性灑脫、不拘小節了?

此圖片源於網絡

十年前,郭碧婷憑借一頭烏黑亮麗的長直發驚豔衆人,宛如現實中的洗發水廣告女主角,一度封神。而如今,她素顏現身街頭,頂着被調侃爲“道姑頭”的丸子頭造型。這或許只是她的個人風格選擇,但不得不說,這樣的造型在一定程度上似乎拉低了她往日的超高顏值。

此圖片源自網絡

然而定睛細瞧未經修飾的原圖,她的發量依舊豐厚得令人豔羨不已。側顏的线條明晰流暢,雖說身形纖瘦,可整體狀態卻顯得闲適自然。這哪裏算得上是顏值下滑?分明是憑借出衆顏值肆意灑脫的絕佳範例!

此圖片源於網絡

此圖片源自網絡

自嫁入向家並誕下一兒一女後,郭碧婷便徹底從娛樂圈隱退。婆婆向太曾公开表示,郭碧婷只需專注於照顧孩子,至於賺錢的事,就交給向佐以及自己來承擔。

此圖片源自網絡

當下,向佐投身於直播帶貨的忙碌之中,向太更是穩坐抖音帶貨一姐的寶座。與之形成鮮明對比的是,郭碧婷正陪伴着父親开啓全球之旅。不得不說,郭碧婷這種不走尋常路的反豪門姿態,實在是“贏麻了”。

圖片源於網絡

無需維系女明星的閃耀光環,不必配合伴侶刻意秀甜蜜,甚至在穿衣風格上也完全實現了自由隨性。然而,恰恰是這樣的明星,似乎更能贏得大衆的喜愛與認可。她們毫無明星架子,親切得就像身邊的朋友,實在太接地氣了!

大夥喜愛郭碧婷嗎?

標題:41歲郭碧婷近照曝光,丸子頭打扮一言難盡,形象全靠顏值撐着!

聲明: 本文版權屬原作者。轉載內容僅供資訊傳遞,不涉及任何投資建議。如有侵權,請立即告知,我們將儘速處理。感謝您的理解。